Етапи стратегічного планування NATO Defence Planning Process

Фреймворк якості даних (Data Quality — DQ) є частиною збірки продуктів управління даними, що підтримують поточну цифрову трансформацію НАТО — разом із ключовими документами, такими як «Стратегія даних для Альянсу», «Дані як основа: референсна архітектура Альянсу (DCRA)», «Стратегічний план Data Exploitation Framework (DEF)» та «Політика управління даними».

Фреймворк DQ для Альянсу доповнює низку паралельних робочих напрямів, зокрема «Стратегію реалізації цифрової трансформації (DTIS)», «Екосистему обміну даними Альянсу (ADSE)» та «Стратегію штучного інтелекту (AI Strategy)».

Увага! Це адаптований перклад публікації - https://www.nato.int/en/about-us/official-texts-and-resources/official-texts/2025/08/29/data-quality-framework-for-the-alliance?selectedLocale=

Передумови (Background)

У 2008 році Північно-Атлантична рада (NAC) ухвалила «Політику управління інформацією НАТО (NIMP)», яка визначила ключові принципи ефективного, результативного та безпечного управління інформацією. Пізніше була прийнята «Політика управління даними (DMP)», яка уточнила, як дані, будучи застосованими в контексті, набувають значення і перетворюються на цінну інформацію.

Стратегічна мета НАТО — досягнення інформаційної переваги та ухвалення рішень на основі даних на тактичному, оперативному та стратегічному рівнях — підтвердила необхідність повноцінного використання даних¹ як стратегічного активу. Політика «Data Exploitation Framework (DEF)» підкреслила взаємозамінність понять «дані» та «інформація», а «Стратегічний план DEF» визначив напрями діяльності (Lines of Effort, LoEs) для використання даних серед союзників і в структурах НАТО.

Одним із таких напрямів є розробка Фреймворку якості даних НАТО для підтримки реалізації принципів політики DEF. Фреймворк встановлює узгоджений підхід до оцінювання та підвищення якості даних і надає рекомендації для союзників, структур НАТО та партнерів щодо створення якісних даних для надійного й безпечного використання, а також для навчання аналітичних інструментів, що використовують штучний інтелект (AI).

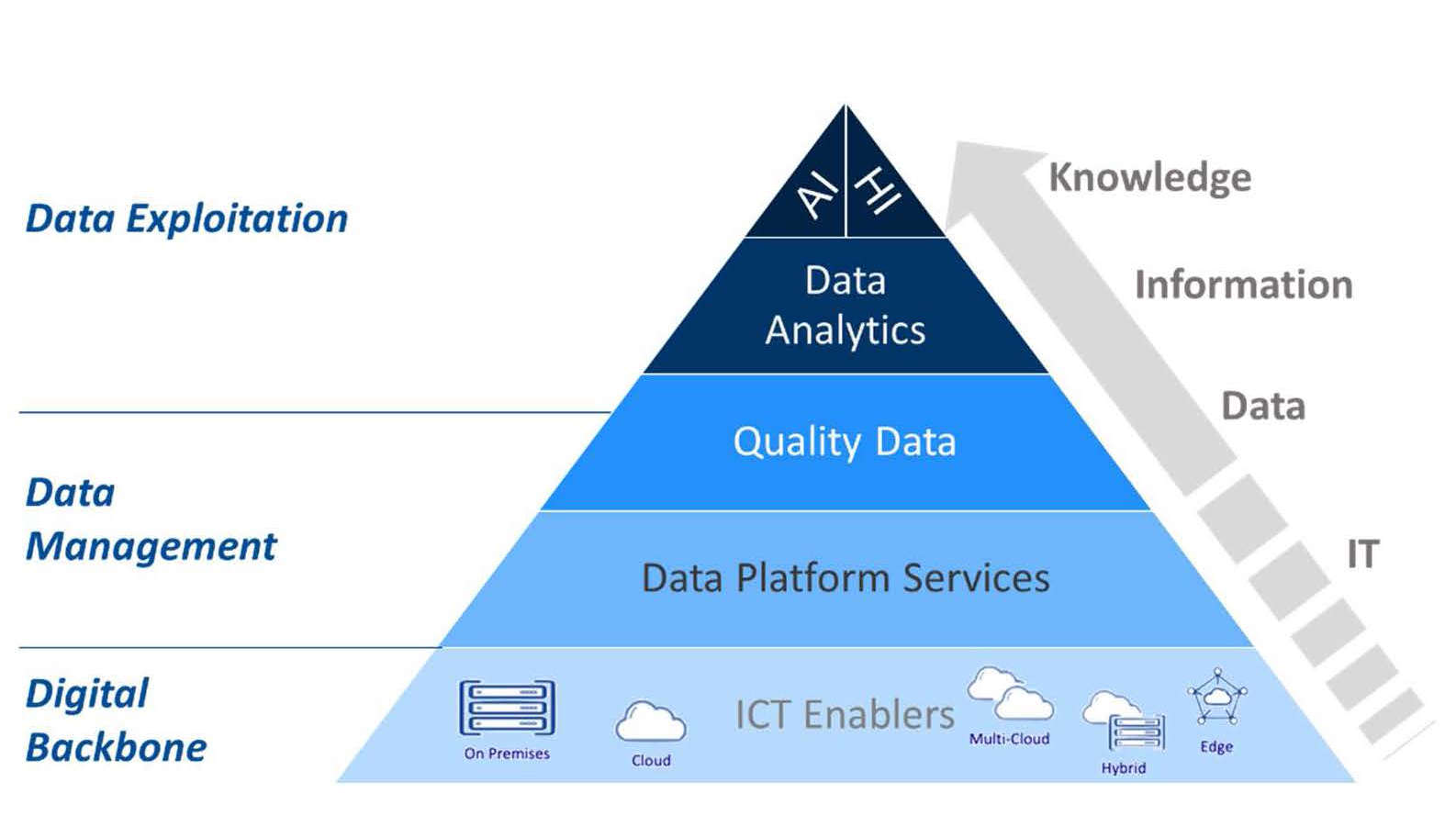

Покращення доступу до якісних даних по всьому Альянсу є ключовим елементом стратегії НАТО з ефективного використання даних. Ці зусилля спираються на ініціативи зі створення спроможностей цифрової трансформації та цифрового управління, а також на формування «Цифрового хребта НАТО» (NATO Digital Backbone).

Шлях Альянсу до перетворення на організацію, орієнтовану на дані, залежить від нових процесів і технологій, у центрі яких лежать якісні дані.

Мета (Aim)

Фреймворк DQ має на меті гармонізувати політики НАТО, пов’язані з даними, встановивши спільне розуміння принципів, концепцій і визначень, необхідних для того, щоб розглядати дані як стратегічний актив — збирання, захист, управління та обмін якими здійснюється ефективно. Він спрямовує спільні зусилля структур НАТО, союзників і партнерів щодо оцінювання, управління та покращення якості даних, які генеруються, передаються або використовуються.

Фреймворк визначає необхідні структури та описує ключові атрибути якості даних, надає рекомендації щодо оновлення відповідних політик, директив, стандартів та інструментів, а також визначає подальші кроки щодо впровадження процесів, практик і процедур забезпечення якості даних.

Застосування Фреймворку якості даних НАТО

Фреймворк організовано навколо таких елементів:

- Виміри якості даних (Data Quality Dimensions), за якими можна здійснювати регулярні та автоматизовані оцінки якості даних.

- Метадані якості даних, що підтримують використання існуючих стандартів метаданих НАТО для представлення рівня якості даних.

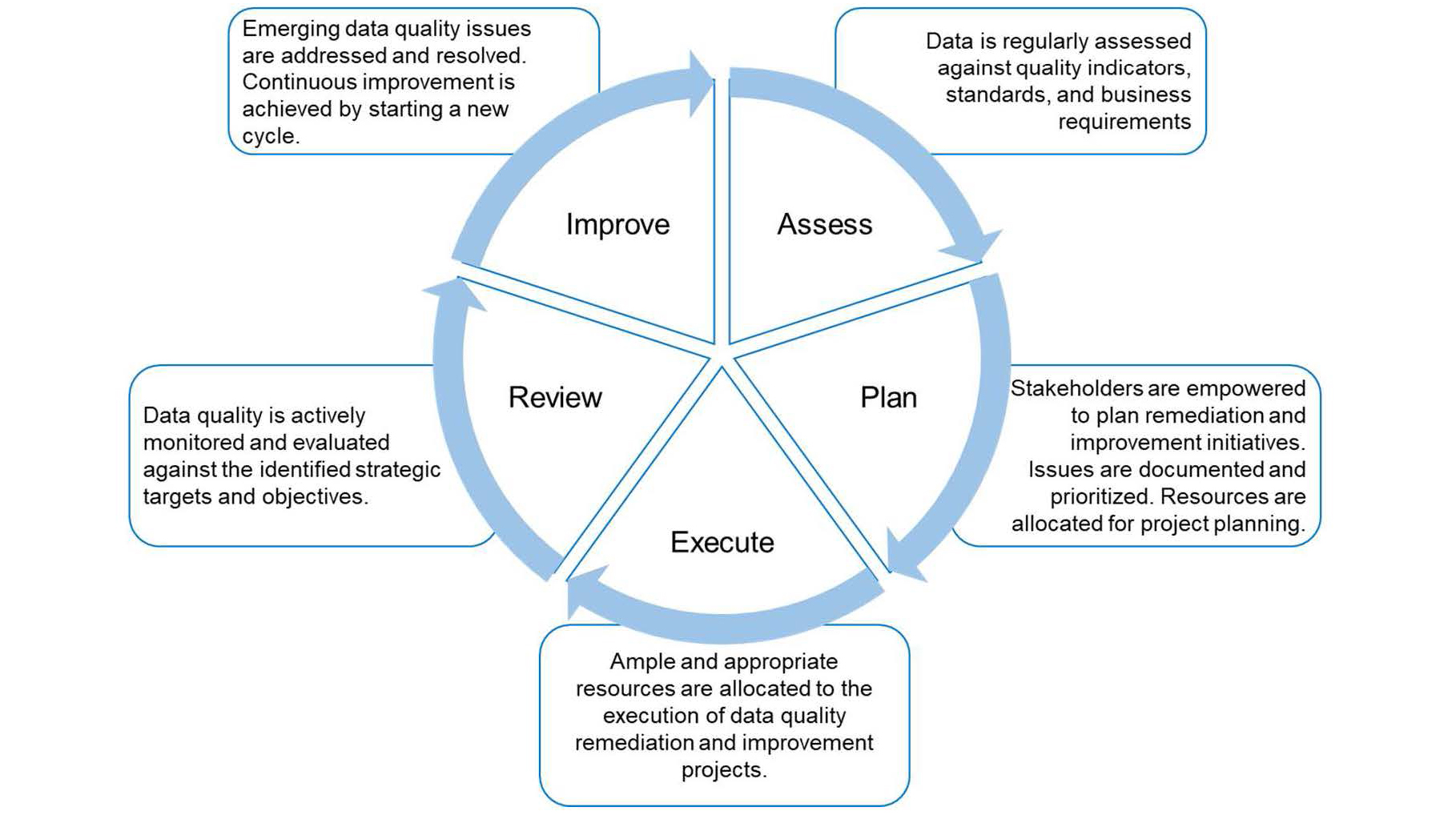

- Управління якістю даних — як ітеративний цикл для виявлення, пом’якшення і виправлення проблем якості даних на всіх етапах життєвого циклу використання даних.

На підтримку цих елементів фреймворк містить практичні рекомендації та інструменти для оцінювання, комунікації та покращення якості даних:

- Кодекс найкращих практик щодо якості даних.

- Рекомендації щодо якості даних у Data-Centric Reference Architecture — з акцентом на цілісності даних у життєвому циклі API.

- Рекомендації для ML Ops щодо якості даних — на підтримку відповідальних інструментів і стандартів AI.

Виміри та індикатори якості даних — Як вимірювати якість

Виміри якості даних (DQ Dimensions) — це набір вимірюваних атрибутів даних, які можна оцінювати окремо, інтерпретувати та покращувати. Вони дозволяють ідентифікувати проблеми якості даних за загальновизнаними характеристиками.

Виміри якості даних НАТО:

- Точність (Accuracy): наскільки дані відображають реальні об’єкти або події.

- Повнота (Completeness): чи містяться всі дані, необхідні для конкретного використання.

- Послідовність (Consistency): відсутність суперечностей між даними в різних наборах.

- Унікальність (Uniqueness): відсутність дублювання даних.

- Своєчасність (Timeliness): актуальність та відсутність затримок щодо оновлення.

- Валідність (Validity): відповідність стандартам або бізнес-правилам.

- Гранулярність (Granularity): рівень деталізації даних.

Індикатори якості даних (DQI) — це засоби вимірювання цих атрибутів. Вони поєднують профілювання даних (що є) та валідацію (що має бути).

DQI залежать від типу даних (числові, категоріальні, геопросторові, візуальні тощо) та контексту використання.

Використання вимірів та індикаторів дозволяє:

- кількісно та якісно вимірювати якість;

- встановлювати та моніторити цільові показники;

- підтримувати процеси управління та контролю даних;

- оцінювати системи та ПЗ, що генерують дані;

- забезпечувати відповідальне використання AI.

Оцінювання якості даних на основі життєвого циклу

Якість даних залежить від етапів їх життєвого циклу: від створення до архівування. Дані перетворюються з «сирих» у «кураторські» (готові до аналізу), проходячи очищення, злиття, анотацію, контроль якості тощо.

Ключові визначальні чинники якості:

- Походження даних (provenance): документування джерела та контексту.

- Лінія походження (lineage): відстеження трансформацій та руху даних.

Обидва елементи відображаються в метаданих і дозволяють оцінити, наскільки дані підходять для використання.

Метадані якості даних (DQM)

Метадані про якість критично важливі, оскільки дозволяють ухвалювати рішення відповідно до рівня якості конкретного набору даних.

До них належать:

- оцінка атрибутів якості за вимірами;

- дані про provenance, lineage, mapping;

- метадані відповідно до ключових принципів даних² (доступність, довіра, безпека тощо).

Підтримка та актуальність таких метаданих забезпечують швидше та більш релевантне ухвалення рішень.

Управління якістю даних (Data Quality Management)

Якість даних підтримується через системний підхід, що поєднує людей, процеси та технології. Управління якістю включає:

- Контроль якості: моніторинг відповідності, управління ризиками, автоматизовані інструменти.

- Забезпечення якості: розробка метрик, тестування відповідності, оцінювання результатів.

- Покращення якості: аналіз причин проблем, усунення недоліків, удосконалення процесів.

Підхід є ітеративним і базується на циклі DAMA (рисунок 2 у документі).

Технологічні складники забезпечення якості

Автоматизація може значно підвищити ефективність управління якістю даних на всіх етапах їх життєвого циклу.

Приклади:

1. Автоматизація життєвого циклу даних

- автоматизоване введення даних (у т.ч. IoT);

- системи master-даних;

- автоматична валідація;

- шифрування, маскування;

- видалення застарілих даних.

2. Цифрові рішення для забезпечення якості

- профілювання та сканування даних;

- тестування відповідності;

- автоматизовані workflow для виправлення;

- моніторинг у реальному часі (у т.ч. AI/ML).

Примітки

- Дані включають: дані НАТО, національні, комерційні та відкриті дані.

- Ключові принципи даних НАТО: доступність, виявлення, довіра, регульованість, інтероперабельність і кураторство, спільність, безпека.

- IoT у військовій сфері зменшує ризики помилок і затримок.